编译 | 韩宇晨 吴斯铭 张译 穆永誉

单位 | 东北大学自然语言处理实验室

原文链接 | https://ruder.io/nlp-benchmarking/index.html#large-scale-continuous-evaluation (opens new window)

# 01.作者介绍

Sebastian Ruder (opens new window),Google研究员、前DeepMind研究员。曾在Insight数据分析研究中心 (opens new window)完成了自然语言处理和深度学习博士学位,同时在德国都柏林的文本分析初创公司AYLIEN (opens new window)担任研究科学家。曾与Microsoft (opens new window)、IBM的Extreme Blue (opens new window)、Google Summer of Code (opens new window)和SAP (opens new window)合作过。

# 02.译者说

每一个做NLP研究的同学,心里肯定有几个“耿耿于怀”的名字,那就是自己研究领域的数据集和评价指标。像iwslt 14、WMT 14/16和BLEU,早已成为多少机器翻译研究者日思夜想、辗转反侧的“那个ta”。对于做端到端语音翻译研究的译者来说,MUSTC(一个多语种端到端语音翻译数据集,每个样本包含源语言语音,源语言的转录,目标语言翻译)也成了译者心中的那颗“朱砂痣”,在上面试出了个BLEU高的模型,则满心欢喜;模型不work,则又忧愁满面。总之,对它是又爱又恨,但还是下了决心要陪着它一起走过这段打怪升级的科研时光。

但话说回来,既然选择陪着它,那就得去深入了解甚至“拿捏”它。在译者研一的机器翻译课上,老师问道:“你们谁知道WMT 14上ppl、BLEU最好能刷到多少?”这句话让刚刚入门机器翻译的我颇为不解:“为什么要在WMT 14上刷?为什么要看ppl和BLEU??为什么要记住那个最好的值???”带着诸多困惑,我找到并阅读了这篇文章,有了自己的一些理解:深度学习任何领域的模型的好坏与否,都需要一个该领域公认的基准(benchmark)来衡量,甚至优秀的基准可以让一个领域得到长足的发展。回到刚才的疑问,WMT 14足够大而稳定,避免了小数据集容易过拟合的不足,ppl则是定量评估生成模型的传统指标,BLEU是定量评估翻译质量的经典指标,它们组成了机器翻译领域的一套基准。遍地生花的Transformer模型就是在这个基准的考验下走出来的:在当时,一个Transformer单模型的BLEU得分便击败了当时最好模型的集成系统,成为当时机器翻译技术的最前沿。因此,想做最前沿的创新,就要知道我们现在站在哪里,也就有必要记住benchmark上的最好的分数。

然而,对于基准的理解到这里为止还远远不够。随着AI领域的“内卷”,一些与基准有关的问题也浮出水面。我们发现,最近很多模型在基准上的得分已经超越了人类水平,这无疑给我们对模型真实能力的判断带来了困难,比较典型的例子是译者所在的实验室参加的WMT 2021比赛中英赛道上人工评价是第一名,而自动评价(也即BLEU得分)排名则不是很靠前。这个反差值得人们思考:是模型的能力已经强到人类无法评价了,还是现有的指标对模型解决现实世界问题能力的衡量已经不够准确了呢?如果答案是前者,我们该如何应对;如果是后者,我们又该如何处理?另外,不同领域的“内卷”程度也大不相同,比如语音上的基准Librispeech,已经要被刷的过拟合了;而有的领域如多模态机器翻译、端到端语音翻译等,还急需一些更大规模、更高质量的基准。总之,不论什么时候,构建更高质量的基准都是非常有价值的事情。那么,如何构建基准以及什么是高质量的基准?一系列问题,希望你能通过阅读下文来找到答案。

# 03.译文大纲

# 04.译文

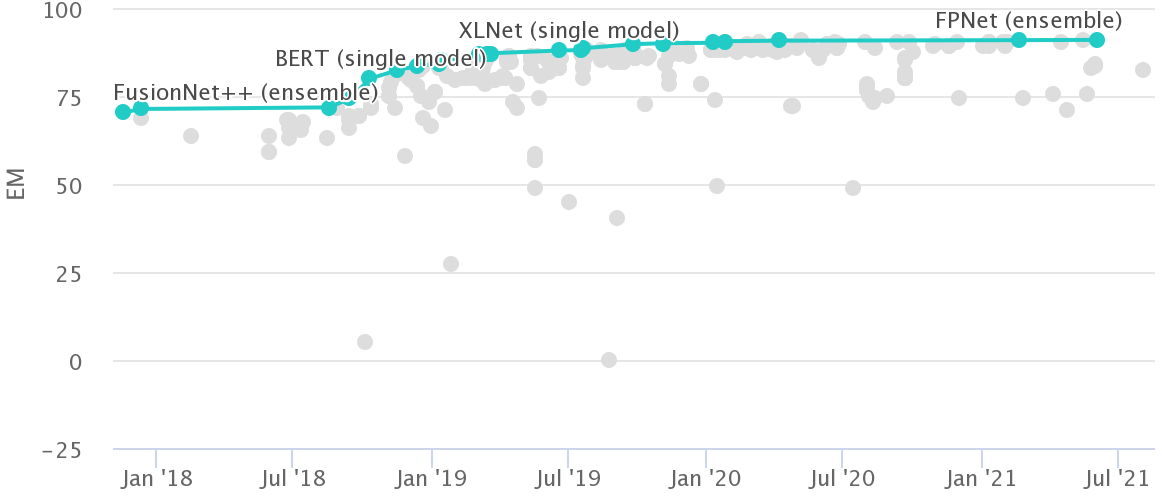

标题图片:SQuAD 2.0 (opens new window)随时间推移的性能(图源:Papers with Code (opens new window))

过去的几年里,在迁移学习 (opens new window)的推动下,NLP模型变得愈发强大。这种性能急剧增加的后果是:现有基准已经无法很好地衡量模型性能。最近的模型“已经超过了测试它们的基准”([2021年人工智能指数报告),在SuperGLUE (opens new window)和SQuAD (opens new window)等测试基准上迅速达到超越人类水平的性能。但这是否意味着我们已经实现了机器处理自然语言这个终极目标?——远非如此。

鉴于模型的自然语言理解能力已经非常强大(至少从表面上看起来是这样),无论是使用单一的指标(如准确率或BLEU)或者是依赖静态基准抑或是使用任务特定的模型评价公式都无法有效评估现有NLP模型的性能。因此,我们需要重新考虑如何设计基准和如何评估模型,以便它们可以作为衡量未来进展的有效的指标。

这篇文章旨在概述NLP基准中的机遇和挑战,以及一些建议。除了作者自己的一些想法之外,还涵盖了最近的论文、ACL 2021 上的演讲以及 ACL 2021 基准研讨会:过去、现在和未来 (opens new window)上的观点。

# 什么是基准(benchmark)?

“数据集是我们这个领域的望远镜。”——Aravind Joshi (opens new window)

基准最初(译者注:约1842年证实。该说法来自维基)是指土地测量员 (opens new window)在石质结构上做的水平标记,可以将角铁放入其中,形成一个用于水准尺 (opens new window)的“bench”。(译者注:“bench”是来自19世纪土地测量的行话,意思是一种支架。该说法来自维基。)形象地说,基准是指可以与之进行比较的标准参考点。在 ML 和 NLP 中常见的基准通常包括:一个或多个数据集、一个或多个关联指标以及评价模型综合能力的方法。

土地测量员(图源:维基)

基准是被整个领域认同的、为评估不同系统的性能而设定的标准。为了确保基准能被整个领域接受,近年来,许多基准要么选择一组具有代表性的标准任务,如 GLUE (opens new window) 或 XTREME (opens new window),要么积极向社区征求任务建议,如 SuperGLUE (opens new window)、GEM (opens new window)或 BIG-Bench (opens new window)。

对于专业人员来说,基准是跟踪进度的重要工具。Aravind Joshi (opens new window)说,没有基准来评估我们模型的性能,就好比“天文学家想要看到恒星,但拒绝建造望远镜”。

无论是从业者还是圈外人,基准都为他们在某领域提供了一个客观的视角,使他们能够找出优秀的模型并跟踪一个领域的进展。例如,《2021年人工智能指数报告》就使用SuperGLUE和SQuAD作为NLP总体进展的指标。

在那些著名的基准上达到人类的水平通常被视为一个领域的关键里程碑。例如,AlphaFold 2(译者注:AlphaFold 2是DeepMind (opens new window)公司的一个可以预测蛋白质结构的模型)

在CASP 14竞赛中的表现与传统实验方法 (译者注:即人类利用冷冻电子显微镜等复杂仪器观察预测的水平)不相上下,标志着结构生物学领域的重大科学进步 (opens new window)。

# 基准的简要历史

“创建良好的基准比大多数人想象的要难”——John R. Mashey (opens new window)

基准在评估计算系统 (opens new window)的性能方面有着悠久的历史。美国的标准性能评估公司(Standard Performance Evaluation Corporation, SPEC (opens new window))成立于1988年,是致力于计算机硬件性能基准测试的最古老的组织之一,同时也得到了该领域多家知名公司的支持。每年,它都会发布不同的基准集,每个基准集由多项测试程序组成,他们通过测试、计算系统每秒百万条指令数量(MIPS (opens new window))的几何平均值 (opens new window)来衡量计算机系统的性能。

一个与SPEC类似,但仅面向机器学习的机构是MLCommons (opens new window)。它组织了MLPerf (opens new window),这是一系列专注于模型训练和推理的性能基准。和SPEC一样,MLPerf拥有来自学术界和工业界的广泛支持(如斯坦福的DAWNBench (opens new window)或百度的DeepBench (opens new window))。

对于DARPA (opens new window)(美国国防高级研究项目)和NIST (opens new window)(美国国家标准与技术研究院)等美国机构来说,基准在衡量和跟踪科学进展方面起着关键作用。自动语音识别(ASR)的早期基准,如TIMIT (opens new window)和Switchboard (opens new window),起初就是由DARPA资助的(从1986年开始由NIST组织协调)。后来在计算机视觉(CV)领域有影响力的基准如MNIST (opens new window),也是基于NIST的数据创建的。

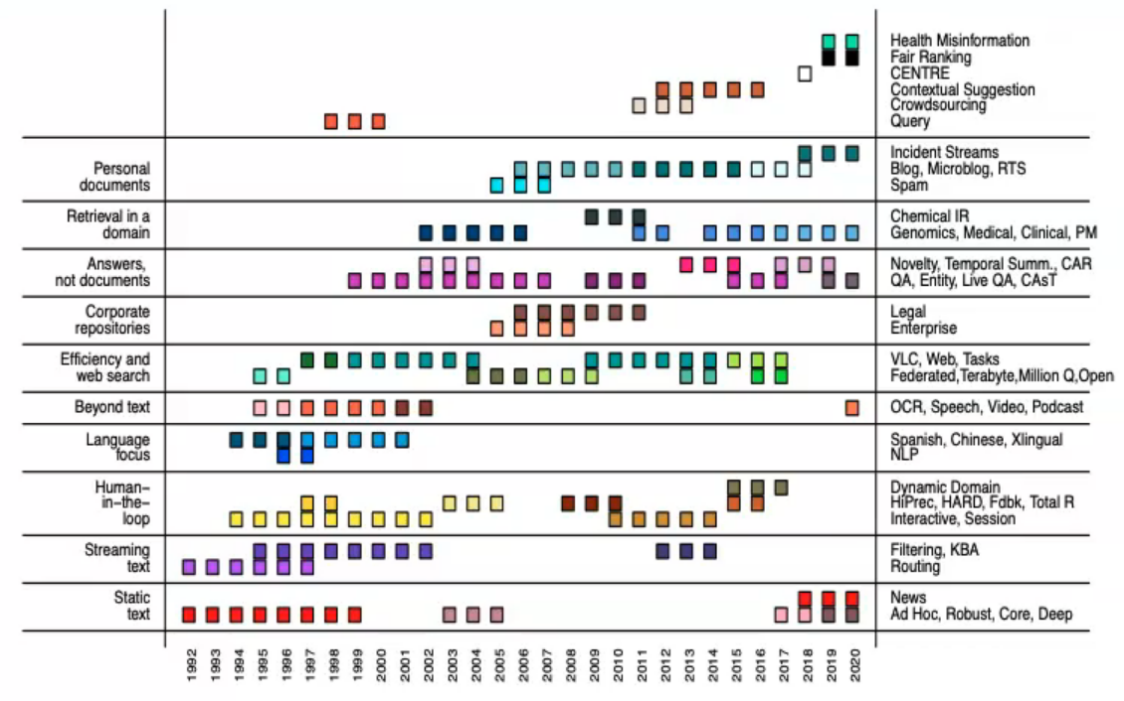

在语言技术和信息检索(IR)领域,NIST举办了由DARPA资助的(Text REtrieval Conference,TREC (opens new window)系列研讨会),涵盖了广泛的轨道和主题,如下图所示。TREC 还组织了基于 Cranfield (opens new window) 在 1960 年代开创的评估范式的竞赛,其中模型根据一组测试集合(包括文档、问题和相关性判断)进行评估。由于不同主题之间的分数差异很大,所以最终分数是在许多主题上的平均分。TREC提供的 "标准、广泛可用且精心构建的数据集为IR的进一步创新奠定了基础"(Varian,2008 (opens new window))。

1992-2020年期间TREC研讨会的任务和主题(图源:Ellen Voorhees (opens new window))

许多最近有影响力的基准如ImageNet (opens new window)、SQuAD (opens new window)或SNLI (opens new window)等,规模都很大(包含数十万个样本),是由资金充足的大学学术团体开发的。在深度学习时代,这种大规模的数据集被认为是推动研究进展的支柱之一。

随着模型变得更加强大、通用,基准也变得更加面向应用,并且越来越多地从单个任务转向多任务、从单一领域转向多个领域。这些趋势的主要例子有:1. 人们的关注点从语言学核心任务如词性标注 (opens new window)和依存分析 (opens new window)过渡到更接近真实世界的任务,如面向目标的对话和开放域问答(Kwiatkowski等人,2019 (opens new window));2. GLUE等多任务数据集以及WILDS (opens new window)等多模态数据集的出现。

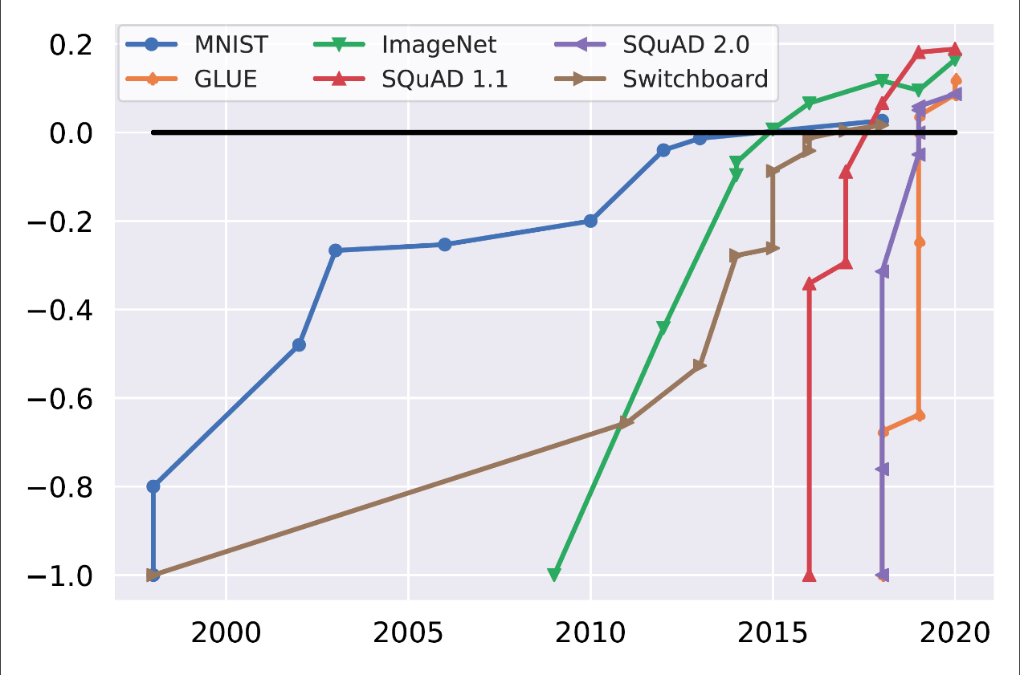

从下图可以看出,虽然在 MNIST 或 Switchboard 等经典基准中,模型实现超越人类水平的性能经历了 15 年多,但在GLUE和SQuAD 2.0等较新的基准上,模型在基准发布后一年左右就实现了超越人类水平的性能。但实际上,我们知道,对于这些基准真正希望测试的一些能力(如模型对一般问题的回答能力),模型还远远没有达到。

热门基准的饱和度随时间的变化。初始性能和人类性能分别归一化为-1和0(图源:Kiela 等人, 2021 (opens new window))

导致这些基准分数饱和的一个因素是:与早期的基准相比,如今的数据集的局限性和人工标注的痕迹可以被更快地发现。(译者注:也就是说模型更容易去捕捉、利用数据集中的“弱点”与“隐形偏好”来实现其在该数据集上非常好的性能表现。)在SNLI中,已被证明其标注人员使用了启发式方法标注数据,这导致模型在许多情况下仅使用假设就能做出正确的预测(Gururangan等人,2018 (opens new window)),而在SQuAD上训练的模型则受到对抗性插入的句子的影响(Jia和Liang,2017 (opens new window))。

在基准领域最近的一个趋势是发展对抗性数据集,如Adversarial NLI(Nie等人,2020 (opens new window))、Beat the AI(Bartolo等人,2020 (opens new window))等。此类基准的一个优点是:它们可以动态更新,从而在新模型出现时仍然具有挑战性,而不会像静态基准那样容易饱和。Dynabench (opens new window)(Kiela等人,2021 (opens new window))是一个促进此类数据集的构建的开源平台。

# 指标(Metrics)

"当你能以一个指标量化你脑中的知识并用数字精确描述它时,这说明你的确知道这个知识。但当你不能这么做时,那么你对这个知识的了解还不够充分。"——Lord Kelvin

当涉及到测量性能时,指标发挥着重要的作用。但它却往往没有得到应有的重视。对于分类任务而言,准确度(accuracy)或F分数(F-score) (opens new window)似乎是理所当然的选择,但根据不同的应用或场景,不同类型的分类错误会带来不同的犯错代价。例如,对于细粒度情感分析来说,错误地将样本分类为正面(positive)和非常正面(very positive)可能不是什么大问题,但混淆非常正面(very positive)和非常负面(very negative)则是个大问题。Chris Potts举了一系列实际的例子 (opens new window),许多例子在某些分类错误上具有更高的犯错代价。面对这些情况,像F-score这样的指标无法足够好地衡量分类结果的好坏。

设计一个好的指标需要相关领域的专业知识。MLPerf (opens new window)测量的是在一个特定数据集上训练一个模型并达到一个预先指定的性能目标所需的时间。这种测量方法的设计既考虑到了终端使用情况,也考虑到了在不同模型之间比较其他效率指标(如FLOPS)的难度。在ASR领域,最初只使用正确转录单词的百分比(类似于准确性)作为性能指标。后来,ASR社区决定采用单词错误率(word error rate) (opens new window),即,因为它直接反映了纠正语音转录错误所需的代价。

正如Mark Liberman (opens new window)所强调的那样,为几十年的研究而设计的指标和为近期的实际应用开发而设计的指标这两者之间存在着很大的区别。对于需要发展数十年的技术,我们需要高效的指标(译者注:这里指使用起来高效的指标,比如机器翻译研究中就不太会使用人工评价,因为人工评价太慢了,我们不可能花费90%的研究时间去等待评测报告出炉。),只要这些指标能够在大方向上与我们的研究目标保持一致,即使稍微粗糙点也无伤大雅。这类指标的例子有ASR中的单词错误率(它假定所有的单词都同样重要)和机器翻译中的BLEU(它假定词序并不重要)。相比之下,对于用于实际生产环境的评价指标,我们需要的是在设计时考虑到具体应用的需求,并且可以考虑不同类型的错误类别的评测指标。

近年来,模型性能的迅速提升使我们在许多情况下可以从探索式的研究模式转变到面向落地的研究模式。然而,即使在这个更加面向落地的大环境下,我们仍然依赖于使用之前用于探索式研究的指标。Marie等人(2021年) (opens new window)发现,尽管在过去十年中,有108个替代指标被提出用于机器翻译译文质量评估——其中许多指标与人工评价更为接近——但2019-2020年间82%的机器翻译(MT)论文只使用BLEU进行评估。随着模型变得更加强大,像BLEU这样的指标不再能够准确识别和比较表现优异的那些模型。

自然语言生成(NLG)模型的评估是出了名的困难,像ROUGE或BLEU这些简单的基于连续n个词重合数量的指标,非常不适合具有丰富语态的语言,并且在这些语言上的分数会相对其他语言较低。

最近NLG的一个研究方向是开发自动指标,如利用大型预训练模型的力量而设计出来的BERTScore(Zhang等人,2020年 (opens new window))。最近,该方法的改进版使其更适合应用于生产环境的机器翻译译文质量评估。该方法会对更难的单词(即只有少数机器翻译系统能正确翻译的单词)分配更大的评估权重(Zhan等人,2021 (opens new window))。

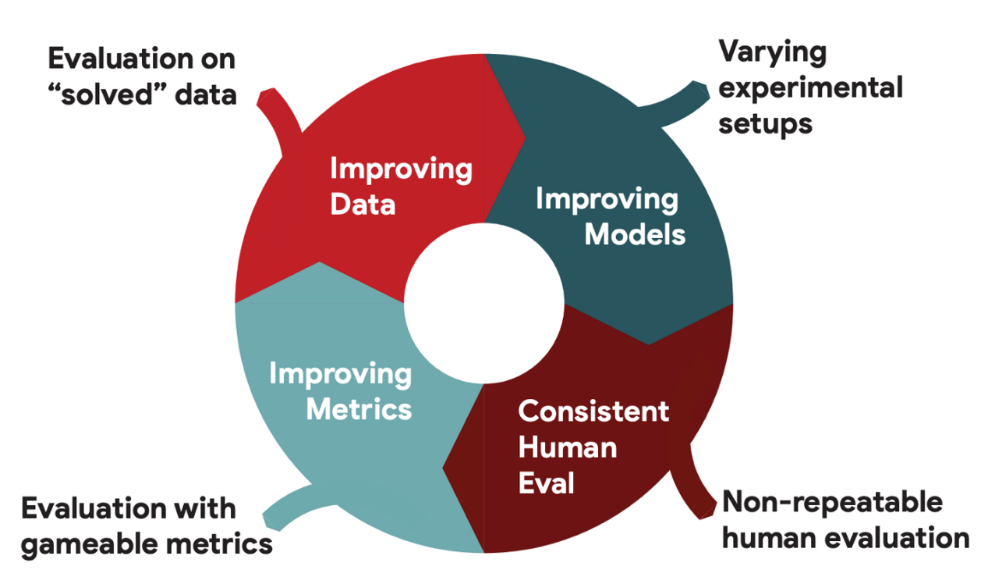

为了让研究继续进步,我们需要不断地更新和完善评测指标,使用针对任务特别设计的指标取代高效的简化指标。例如,最近的GEM基准 (opens new window),明确地将评测指标 (opens new window)当作一个研究部分,并指出其需要逐步改进。如下图所示。

一些建议

考虑使用一些更符合下游任务的指标。

考虑使用一些能够反映因下游任务设置环境不同而带来模型性能变动的指标。

持续更新与优化指标。

# 考虑下游用例

"基准足以指导一个领域的发展。好的基准与实际应用相一致,但坏的基准则不然。这迫使工程师在有助于最终用户或仅仅有利于营销两个发展方向之间做出选择。"——David A. Patterson;《系统基准》(2020) (opens new window)前言

NLP技术不断地被应用于现实世界中,这些应用包含从创造性的AI艺术表达到欺诈检测和推荐系统 (opens new window)。因此,在设计基准时非常关键的一点是要考虑到现实世界的应用场景。

正如Ido Dagan (opens new window)所强调的那样,一个基准的数据组成和评估方法应能够反映现实世界的真实用例。例如,对于关系分类任务,FewRel数据集 (opens new window)缺乏一些重要的现实属性 (opens new window),而Few-shot TACRED数据集 (opens new window)则解决了这个问题。对于在IMDb数据集 (opens new window)上的二元情感分类任务,该数据集只考虑了高度两极化的正面和负面评论,并且每个标签数据量是完全相同的。对于信息检索任务,在与目标信息不相关的文件之前预先检索与目标信息相关的文件是必要的,但对于实际使用来说还需要其他操作才能达到令人满意的效果 (opens new window)。

Chris Potts提出 (opens new window)"完全按照你说的做"应当作为NLP从业者的首要规则。作为该领域的研究人员,我们应该清楚地了解基准上的表现反映了什么,以及这些表现会如何反映在现实世界的应用中。与此类似,Bowman和Dahl(2021) (opens new window)认为,在基准上的良好表现应该意味着在现实世界的该领域上也拥有同样强大的表现。

然而,模型可能会面临真实生产环境中接收的数据与训练该模型的数据不一致的问题。因此,能够评估模型的鲁棒性以及它在未见过的数据上的泛化性能是非常重要的。导致数据不一致的情况包括因时间推移而变得不一致和数据可能来自其他语种。

鉴于NLP研究中有限的语言多样性(Joshi等人,2020年 (opens new window)),未来的研究关键点之一是不要把英语作为基准中的唯一语言。在设计基准时,至少要收集其他语言的测试数据。这可能有助于暴露出新的问题和挑战并促进模型的语言包容性。同样,在评估模型时,利用越来越多的非英语语言数据集来完成诸如问题回答 (opens new window)和总结等任务(Hasan等人,2021 (opens new window)),可以为模型的泛化性能提供额外的实验数据证明。

无论是在现在还是未来的实际应用中,语言技术所面临的挑战都可以为设计新的评估手段和基准提供灵感。基准是我们这个领域中最有影响力的人工创造物之一,并且经常引出全新的研究方向。因此,它们必须既能够评估我们的技术在现实世界中的表现,也要能够反映我们的技术在未来的、可能诞生出新的应用场景下的表现。

一些建议

设计能够反映现实世界应用场景下模型性能的基准。

评估领域内和领域外的泛化能力。

在其他语言上收集数据并评估模型性能。

设计基准时,可以从在现实世界的语言技术应用中获取灵感。

# 细粒度评估

"无论人们多么希望性能能以一个单一的数字来表示,即使是没有误差的正确平均值也会产生误导,而错误的平均值更不会好到哪里去。"——John R. Mashey

模型、技术在下游任务上的使用方法往往也可以为我们选用什么样的指标带来一些启发。特别是对于下游应用来说,往往不只是使用单一的指标,而是需要考虑一系列的约束条件。Rada Mihalcea呼吁不要只关注准确性等指标 (opens new window),而要关注现实世界场景的其他重要方面。在一个特定的环境中什么参数是重要的?或者说一个NLP系统是干什么用的?最终取决于每个用户的个性化需求(Ethayarajh and Jurafsky, 2020 (opens new window))。

在机器学习研究中,其社会属性通常不被重视(Birhane等人,2021 (opens new window))。然而,对于一个能够应用于现实世界的NLP系统来说,它不应该表现出任何有害的社会偏见。因此,在特定任务下测试这种偏见应该成为算法开发和模型评估的标准规范里的一部分。

另一个对实际应用很重要的方面是效率。根据不同的应用,这可能代表采样效率、FLOPS或内存使用效率。在资源受限的情况下评估模型往往可以引出新的研究方向。例如在NeurIPS 2020上的EfficientQA竞赛中,一些研究人员证明了检索增强(Min等人,2020 (opens new window))和大量弱监督问题-答案对(Lewis等人,2021 (opens new window))的优势。

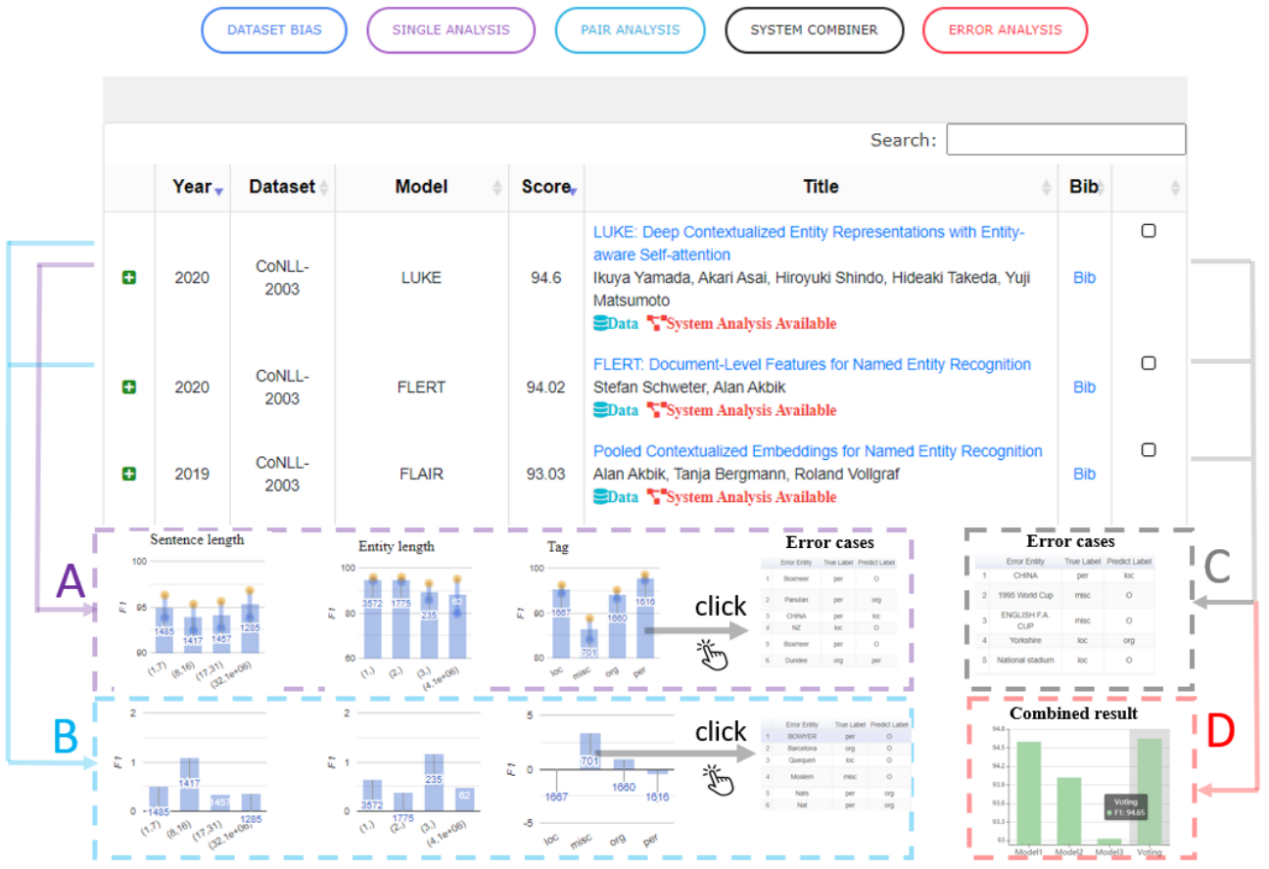

为了更好地了解我们模型的优势和劣势,我们进一步要求在单一指标上进行更精细的评估,希望能够突出模型在哪些类型的用例上表现出色或是不好。如下图所示,用于评测模型的工具ExplainaBoard (opens new window)(Liu 等人, 2021 (opens new window))实现了在不同任务下模型性能的细粒度分析功能。获得对模型性能更细化的评估的另一种方法是为特定场景和模型行为创建测试案例,例如使用CheckList框架(Ribeiro等人,2020 (opens new window))。

由于单个指标可能无法完整地表达模型性能的好坏,因此基准的另一个关键是使用多个指标进行评估。在使用多个指标时,通常需要将分数平均化以获得一个单一的分数。一个单一的分数对于比较模型性能是很有用的,并且为该领域外的人提供了一个明确的评估模型性能的方法。然而,使用算术平均值并不是一个万能的选择。SPEC使用了几何平均数(公式为),这在汇总具有指数性质的数值(例如运行时间)时很有用。

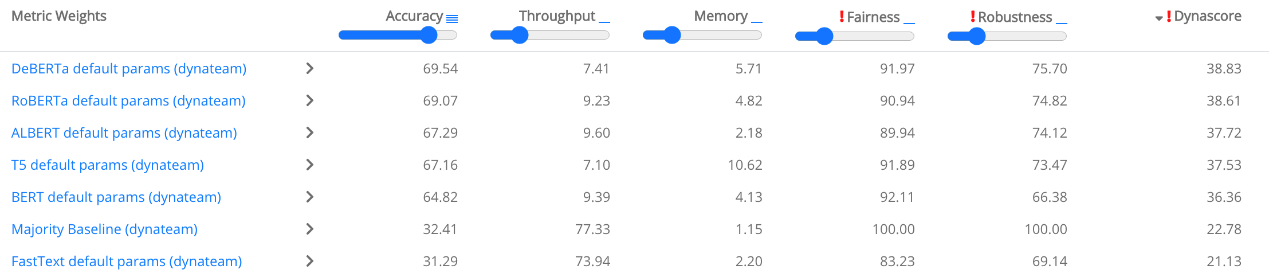

另一种方法是使用加权和,并使用户能够为每个指标定义自己的权重。DynaBench (opens new window)使用的动态加权不仅可以权衡模型性能的重要性,还可以权衡模型的吞吐量、内存消耗、公平性和稳健性的重要性。这使用户能够有效地定义自己的排行榜(Ethayarajh和Jurafsky,2020 (opens new window)),如下所示。

一些建议

避免只使用单一指标来评估模型。

评估模型的社会健全性。

使用细粒度的模型性能评估方法。

思考如何将多个指标的指聚合为一个数字。

# 基准性能的长尾问题

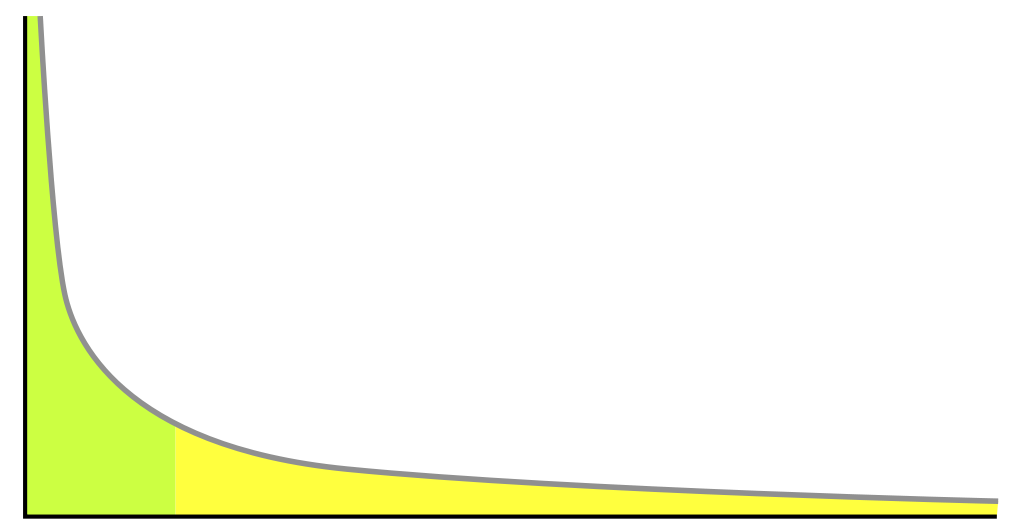

(译者注:长尾可以理解为数据不平衡问题,数据集中不同类别的数据出现频率不平衡。如图1所示,按照出现频率降序排列,数据分布出现一个长尾巴)

鉴于当前模型在大部分数据上表现得很好,我们应该去注意数据分布中的尾部数据以及那些非常规的数据。也就是说,相比于大量常规的数据,我们应该更加关注质量最差的数据及模型表现得不好的那部分数据。

长尾分布(图源:维基百科)

随着模型变得更强大,能够让我们在一众性能优异的模型中筛选出最佳模型的样本变得越来越少。为了保证在长尾的数据上进行的评价是可靠的,基准的数据量需要足够多从而可以检测到模型性能的细微差异。值得注意的是,当考虑所有样本时,更大的模型不一定表现得更好(Zhong 等人, 2021 (opens new window))。

此外,我们可以通过某些方法实现只用少数的样例就能识别出最好的系统。当评价不同系统的代价很高时(比如人工评价自然语言生成),这样的方法是很重要的。Mendonça 等人 (2021) (opens new window)将此视为机器翻译背景下的在线学习问题。

基准同样可以专注于标注那些更有挑战性的样本。这是最近的对抗性基准所采取的方向(Kiela 等人, 2021 (opens new window))。此类基准只要不偏向特定模型,就可以成为从正态分布中采样的常规基准的有效补充。该方向受益于主动评价的发展,识别或生成最重要和最具区分性的样本来评估模型性能,以及采用可解释性方法以允许标注员更好地理解模型的决策边界。

由于基准的规模通常保持不变,显著性检验变得更加重要,因为它使我们能够可靠地检测系统之间的质量差异。

为了获得可靠的模型比较结果,基准的标注应该是正确和可靠的。然而,随着模型变得越来越强大,许多看起来像模型错误的样例可能是由数据本身的歧义导致的。Bowman and Dahl (2021) (opens new window)强调了模型如何利用与歧义相关的提示从而在基准中达到超越人类的水平。

如果可能的话,基准应该收集多个标注结果以识别模棱两可的样例。这些信息可以提供有用的学习信号(Plank 等人, 2014 (opens new window)),并且有助于错误分析。鉴于这种歧义,报告标准指标(例如inter-annotator agreement)更为重要(译者注:inter-annotator agreement,用来衡量一项任务中评分者意见一致的指标),因为这为模型在基准上的性能提供了上限。

一些建议:

基准中的样本既要有足够的数量,又要对模型有挑战性。

进行显著性检验。

为有歧义的样本收集多个标注结果。

报告inter-annotator agreement。

# 大规模连续评价

“当一种衡量方法成为目标时,它就不再是一个好的衡量方法”——Goodhart定律 。

(译者注:这句话的意思是说,如果一种衡量方法被人们当作努力的目标后,人们就可能只让模型在这种衡量方法下实现性能提升,而不顾模型其他表现,导致这种衡量方法不再有效。)

多任务评价指标(如GLUE)是基准发展的里程碑,但此类静态基准很快就会过时。模型的进步通常不会促进不同任务的统一进步。尽管模型在大部分GLUE任务上表现得比人类更好,但在CoLA(Nangia and Bowman, 2019 (opens new window))这样的任务上,模型与人类的表现还有差距。在XTREME (opens new window)基准上,模型跨语言检索的性能已经提高了很多。

因为模型的发展速度很快,我们需要更灵活的模型评价方法。具体来说,除了像DynaBench (opens new window)这样的动态单任务评价之外,在模型表现不如人类的基准数据集上定义一个动态的集合也是有用的。这个集合应该由社区来管理,当模型的表现达到人类水平时,删除对应的数据集或降低对应数据集的权重,并经常在集合中添加新的有挑战性的数据集。为了能在学术审查周期之外进行更新,保证可复制性以及能与先前的方法进行比较,该集合需要进行版本控制。

现有的像GEM (opens new window)(Gehrmann 等人, 2021 (opens new window))这样的多任务基准,为了被人们接受为可用的基准,通常包括了大约10—15种不同的任务。考虑到不断发布的新数据集的数量,相比于将基准限制在几个代表性任务的集合中,在基准中包括更多的不同的NLP任务会是一个更好的选择。由于NLP不同任务的差异性,使用这样的方法构建的基准能够为模型的性能提供更健壮和更有时效性的评价。百度构建的LUGE (opens new window)是一次构建大规模中文nlp任务集合的尝试,LUGE目前包含了28个数据集(译者注:截至翻译时,LUGE包含了39个数据集)。

任务的集合可以通过不同的方式分解,对模型的能力提供更细致的评价。对于模型评价来说,如果能将任务或数据的子集根据“它们能够测试模型什么行为”进行分类,是非常有价值的一件事。BIG-Bench (opens new window)是一个用于语言模型probe的基准,其中包括了按关键字分类的集合(译者注:probe是用来探究模型学习到了什么语言学知识的任务)。

大规模多任务评价的一个关键挑战是易用性。任务需要支持常见的输入格式以方便运行。此外,任务需要能高效运行,或者至少能在不需要大量计算的情况下运行。

一些建议:

- 收集和评价大规模的、多样化的、版本化的NLP任务集合。

# 总结

为了让评价方法跟上模型的发展,我们需要重新思考许多如今常用的评价方法,如F1值和BLEU等单一指标。在设计新的评价方法时,我们应该给予nlp的实际应用更多的关注,并考虑实际应用对模型的约束和要求。此外,我们需要注意尾部的数据,因为改善模型在尾部数据上的表现是许多应用中提高性能的关键所在。最后,与当前趋势 (opens new window)不同的是,我们需要使用多种指标以及显著性检验更细致地评价模型。